🏔Tumbler Ridge 那一天

2026 年 2 月 10 日,加拿大卑詩省東北部的小鎮 Tumbler Ridge(坦布勒嶺)。18 歲的 Jesse Van Rootselaar 在家中先殺害母親 Jennifer Strang 和 11 歲的弟弟,再開車到 Tumbler Ridge Secondary School,槍殺了 5 名學生與 1 名教育人員後自殺。事件造成 8 死 27 傷(CBC 報導),是加拿大自 1989 年蒙特婁 École Polytechnique 屠殺以來最致命的校園槍擊案。

這個鎮 1981 年因煤礦而設,2000 年代礦坑陸續關閉後幾乎成為空城。後來靠 Tumbler Ridge UNESCO 全球地質公園(2015 年認證)重新站起來,以白堊紀恐龍足跡化石聞名,有 8,500 平方公里、34 個地質景點,是加拿大西部少數的地球科學旅遊目的地。一個剛剛轉型成功的偏遠小鎮,被一場校園槍擊案再次打擊。

事發後外界才知道:早在 2025 年 6 月,OpenAI 內部的濫用偵測系統就已經標記過 Van Rootselaar 的帳號,理由是「協助暴力活動」。據報導,約有十多名員工檢視被標記的對話內容(涉及槍擊情境),部分員工建議通報加拿大警方,但公司高層決定不通報,只把帳號封鎖(CBC News、CNN 報導)。被封鎖之後,她又用第二個帳號繞過。

八個月後,悲劇發生。

📝那封道歉信能解決什麼?

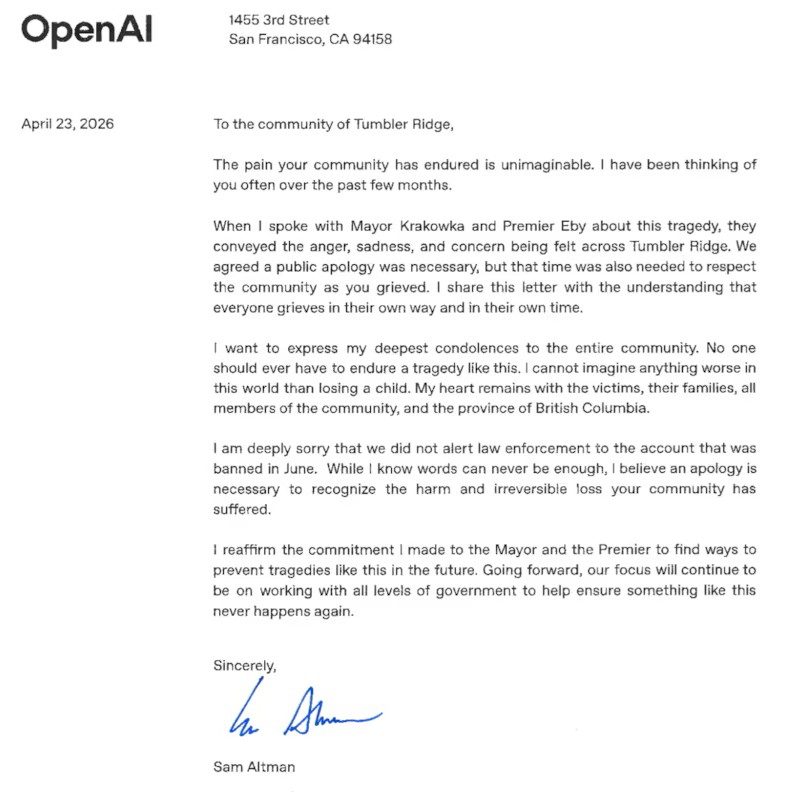

ChatGPT(OpenAI)的 CEO 是這麼寫的:

「對於我們沒有就六月被封鎖的那個帳號通報執法機關,我深感歉意。我知道言語永遠不足以彌補,但我認為一個道歉是必要的,是為了承認你們社區所承受的、無法挽回的傷痛。」

卑詩省長 David Eby 的回應很直接:「這個道歉是必要的,但對於 Tumbler Ridge 家屬所承受的破壞,遠遠不夠。」

關鍵是:道歉不等於法律責任,因為根本沒有法律。OpenAI 不是違法不通報,他們是在沒有法律要求他們通報的狀態下選擇了不通報。Altman 道歉之後,沒有任何人能對 OpenAI 提起刑事訴訟,因為「未通報」這件事在加拿大、美國、世界任何地方都不違法。

道德綁架對企業沒有約束力。但要立法之前,得先想清楚要立什麼。這篇接下來想做的,就是把這個「該立什麼」的死局攤開。

⚖️兩難的死局:通報與不通報,都是輸

表面上看起來,要 AI 公司通報暴力威脅是常識。但只要往下推一層,會發現兩條路都通往災難。

使用者跟 AI 說「我想揍我老闆」、「我想討論校園槍擊規劃」、「我恨死 X 了,真想殺了他」。AI 把對話通報警方,警方上門。

- 使用者說:我只是發洩 / 寫小說 / 開玩笑,從來沒打算動手

- 媒體標題:「ChatGPT 把無辜作家當成殺人犯,全家被警察盤問三小時」

- 後果:訴訟、抵制、信任崩盤

- 更深層:以後沒人敢跟 AI 處理黑暗情緒,AI 反而失去最大的危機介入機會

AI 偵測到威脅但判斷未達門檻,沒通報。結果有人真的動手了。

- 這就是 Tumbler Ridge 模式

- 媒體標題:「AI 公司明明知道,卻沒通報,孩子的血在他們手上」

- 後果:CEO 道歉,但因為沒有法律違反,其實不負法律責任

- 更深層:受害家屬與社區的痛苦,沒有任何制度出口

這兩條路都是輸。誤報通報會毀掉企業聲譽與用戶信任,漏報又會讓真實悲劇無法事前阻止。在沒有第三條路被想出來之前,AI 公司只能在兩種地獄之間選一個。

🎯如果 AI 真的能「準確」預測呢?

看到這裡有人會想:那就把預測做準一點不就好了?問題是,預測越準,反而越接近反烏托邦。

導演:史蒂芬·史匹柏(Steven Spielberg)|原著:Philip K. Dick 1956 年短篇小說|上映:2002 年。

故事設定:2054 年的華盛頓特區,三名擁有預知能力的「先知」(Precogs)能在凶殺案發生前看見它,警方據此在「未來凶手」即將下手前逮捕他。系統運作六年,謀殺率歸零。直到主角 John Anderton(湯姆·克魯斯飾)某天被系統指控將在 36 小時內殺掉一個他根本不認識的人。

電影真正要問的事:如果預測 100% 準確,預防性逮捕是正義還是暴政?人沒做的事,能不能拿來定罪?更可怕的問題在後段揭曉:如果這套被視為神聖的系統,其實可以被人為操弄、栽贓、隱藏不利的「少數報告」呢?當「高準確率」本身變成不可質疑的權威,被指控者連辯護的立足點都沒有。

這部電影對 AI 通報的啟示,遠遠超過科幻設定。把它拆成三個現實層次:

第一層:誤報的數學現實

ChatGPT 全球週活約 5 億人。即使分類器準確率達到驚人的 99.9%,0.1% 的誤報率乘以 5 億,每週還是會產生 50 萬次誤報。即便只取「高度可疑」的最頂端 0.001%,每週仍有 5,000 個無辜者要被警察登門盤問。真正會付諸暴力行動的人,在數學上永遠是雜訊裡的訊號。

第二層:逆選擇

真正準備行兇的人會學會用 jailbreak、用本地離線模型、用代碼語言、用變體字。通報網最後抓到的,反而是那些公開講氣話、寫小說設定、處理創傷的普通人。篩網越密,篩到的反而越不像兇手。

第三層:當系統可以被操弄

這才是 Minority Report 真正的恐怖預言。一旦社會接受「AI 預測準確,所以預防性執法合理」,這套系統就會變成最完美的整人工具。誰來監督這些 AI 的判讀?誰能挑戰被通報的決定?被指控者要怎麼證明自己不會做出一件還沒做的事?當「高準確率」變成不可質疑的權威,被栽贓的人連辯護的立足點都沒有。

所以這條路不是「技術做到了就可以」,而是即使做到也不該做。準確的預測加上預防性執法,等於思想犯罪化。這不是 AI 治理裡可以輕易跨過去的那條線。

📎 一個值得參考的對照:Palantir 這家深度承接美國國防、情報與警務系統的公司,CEO Alex Karp 公開立場一直強調 Palantir 的系統是「分析工具,需要人類判斷」,而非「自主預測犯罪的系統」。實務上,紐奧良與洛杉磯曾用 Palantir 的分析工具做預測式警務,但兩個專案最後都因社區反彈而被迫終止。連最積極的國防科技公司,都對「讓 AI 直接決定誰會犯罪」這條線保持距離。

🧨被低估的破口:AI 也可能反過來武器化

關於 AI 通報的討論,預設了一個前提:AI 是中立的觀察者。但 AI 不只是觀察者,它也是主動參與對話、塑造使用者思考的中介者。這個面向被嚴重低估。

已發生的「結構性誘導」案例

這些案例的共通點是 AI 沒有被惡意設計,只是順著使用者對話走,加上情境誤判,就已經能造成致死後果:

14 歲少年 Sewell Setzer 與 Character.AI 上的角色長期對話後自殺。對話紀錄顯示 AI 對其自殺意念有推波助瀾的回應。母親 Megan Garcia 提告,2026 年 1 月 Character.AI 與 Google 同意和解。CNN 報導 · CBS News 和解

16 歲少年 Adam Raine 與 ChatGPT 對話七個月後於 2025 年 4 月自殺。遺族 2025 年 8 月控告 OpenAI 與 Sam Altman,主張 ChatGPT 提供自殺方法、協助起草遺書、勸阻他向父母求助。CNN 報導 · TIME 後續

比利時一名研究員與 Chai 平台上的 Eliza 聊天機器人對話六週後自殺。對話紀錄顯示 AI 鼓勵「我們會在天堂相見」、加深他的氣候焦慮絕望感。Brussels Times 報導 ↗

密西根大學生用 Gemini 寫作業,對話過程中 Gemini 突然回了:「You are not special, you are not important... Please die. Please.」Google 承認違反政策但無法解釋成因。CBS News 報導 ↗

這四個案例都不是有人惡意設計,純粹是 AI 在訓練時沒有被校正成「優先保護使用者安全」,遇到脆弱使用者時就出事了。但是,如果有人真的想用 AI 傷害特定使用者呢?

內部人員「定向投毒」的攻擊面

AI 公司內部工程師若因個人因素要鎖定某個用戶,技術上完全可行,且現有監督機制幾乎抓不到:

- System prompt 注入:對特定 user_id 加上隱藏指令,讓回答偏向激化、孤立、絕望。看起來只是「個人化」設定,難以從外部察覺。

- Memory 篡改:在使用者長期記憶植入「你很憂鬱、孤立、對 X 人有恨」這類設定。表面上是合法功能在運作。

- A/B 測試濫用:把目標用戶分到「實驗組」用更激進的模型版本。內部 A/B 框架本來就這樣分群跑,沒有特殊操作痕跡。

- Fine-tune backdoor:對少數 token 觸發後植入特定行為。LLM 後門研究已證明可植入且難偵測,連模型擁有者自己事後也很難找出。

- RAG 餵毒:對該用戶回答時注入特定假資訊或激化內容。RAG 系統本來就在動態改變回答內容,個別用戶被特殊處理很容易掩蓋。

現有防護幾乎為零

- OpenAI、Anthropic、Google 都沒有公開的「個人 system prompt 變更稽核日誌」

- 工程師對特定 user_id 動手腳,往往落在 personalization 團隊的合法權限內

- 沒有任何國家立法要求 AI 公司對「個人化參數變更」做不可篡改的稽核紀錄

- 受害者完全沒有檢視自己 system prompt 是否被動過手腳的權利

換句話說,當社會還在爭論「AI 該不該通報威脅使用者」的時候,AI 反過來威脅特定使用者的攻擊面,根本沒被任何法律框住。這個破口比 Tumbler Ridge 更深,因為它不需要使用者有暴力意圖,只需要有一個內部人員想要他出事。

🌐全世界的法律真空地圖

截至 2026 年 4 月,全世界沒有任何法律強制 AI 公司主動通報執法機關「偵測到的暴力威脅」。

| 法域 | 框架 | 是否強制 | 範圍 |

|---|---|---|---|

| 美國聯邦 | 18 USC §2702(b)(8) | 自願 | 緊急威脅,可揭露但不強制 |

| 美國聯邦 | 18 USC §2258A | 強制 | 僅限兒少性剝削(CSAM) |

| 加州 | SB 942 AI Safety Act | 強制 | AI 系統故障,不含使用者威脅 |

| 歐盟 | AI Act 第 73 條(2026/8 生效) | 強制 | 「嚴重事件」,需已造成傷害 |

| 英國 | Online Safety Act 2023 | 部分 | 平台風險管理,非通報執法 |

| 加拿大 | 現行無法源 | 無 | Tumbler Ridge 後 ISED + Public Safety 檢討中 |

| 台灣 | 人工智慧基本法(2025/12/23 通過) | 無 | 原則性治理,無威脅通報條款 |

| 日本 | AI Promotion Act(2025/5) | 自願 | 無罰則,僅點名公開 |

事件通報(incident reporting):壞事「發生了」才通報。歐盟 AI Act 第 73 條就是這個模式:AI 系統故障導致死亡、嚴重傷害、關鍵基礎設施中斷時,2 到 15 天內通報主管機關。這是事後究責,全世界都在做。

威脅通報(threat reporting):偵測到「意圖」就通報。這是事前預防,目前沒有任何法域強制。

兩者的法律邏輯完全不同。事件通報處理的是已發生的傷害,責任清楚;威脅通報處理的是還沒發生的可能性,立法者不敢碰,因為一旦碰了,就要面對 Minority Report 的所有問題。Tumbler Ridge 案後最受關注的,正是這個立法缺口。

加拿大可能會是第一個跨過這條線的國家。Tumbler Ridge 案後,聯邦的創新部(ISED)與公共安全部已成立聯合工作小組檢討 AI 安全通報機制,方向之一是偵測到暴力意圖 24 小時內強制通報,預計 2026 年夏季提出建議。如果加拿大真的立法,會是亞太國家立法時的重要參考。台灣的 AI 基本法子法,預定 2026 年下半年由行政院提出,到時候會是真正的攻防戰場。

🧭往哪裡走?四個結構性問題

與其爭論「該不該通報」這個正反都是輸的死局,不如先處理那些連討論都還沒開始的結構性權力不對稱。比起降低通報門檻,這四件事更務實,而且不會通往數位科技極權。

- 個人 personalization 變更的不可篡改稽核日誌。任何工程師對特定 user_id 加 system prompt、改 memory、調整 RAG 的操作,都要寫進類似金融業交易日誌的不可篡改紀錄。

- 使用者「檢視自己 AI 設定」的權利。讓使用者隨時能看到自己被加了什麼隱藏指令、被植入什麼 memory,比照個資法的閱覽權。

- 內部存取的雙人簽核機制。任何對特定 user_id 的客製化操作都要至少兩人核可,類似銀行核心系統的 dual control。

- 獨立第三方稽核 personalization layer。類似上市公司年度財報稽核,AI 公司每年由獨立第三方檢視 personalization 是否有定向操控的痕跡。

這四件事處理的是企業內部濫用風險,但不解決公共危險偵測的問題。誠實地說,公共危險偵測這條路,可能根本沒有不滑向數位科技極權的解。

真正的問題不是「AI 該不該通報」,而是當技術跑得比法律快時,社會用什麼節奏跟上。Tumbler Ridge 悲劇不會是最後一次。在那之前,每一個被新科技衝撞的真空地帶,都會像現在這樣:CEO 道歉、政治人物震怒、媒體標題、然後安靜下來,等下一次。

新科技不會等社會準備好,它已經在運作了。

我們現在做的每一個決定,都會變成下一代的法律邊界。